Peki, günlük hayatını sürdürmeye çalışan ortalama bir insan için bu ne anlama geliyor? Güvendiğiniz avukatların, hukukun karmaşık sisteminde yol alırken, açıkçası uydurma bilgiler kullanan araçlar kullanabileceği anlamına geliyor. Boşanma davanızın veya şahsi yaralanma tazminat talebinizin tamamen uydurulmuş yasal emsallere dayandığını hayal edin. Bu artık bilim kurgu değil. Yapay zekanın Büyük Hukuk bürolarının kutsal salonlarına entegrasyonunun kirli, utanç verici gerçeği bu.

İlerleme Yanılsaması

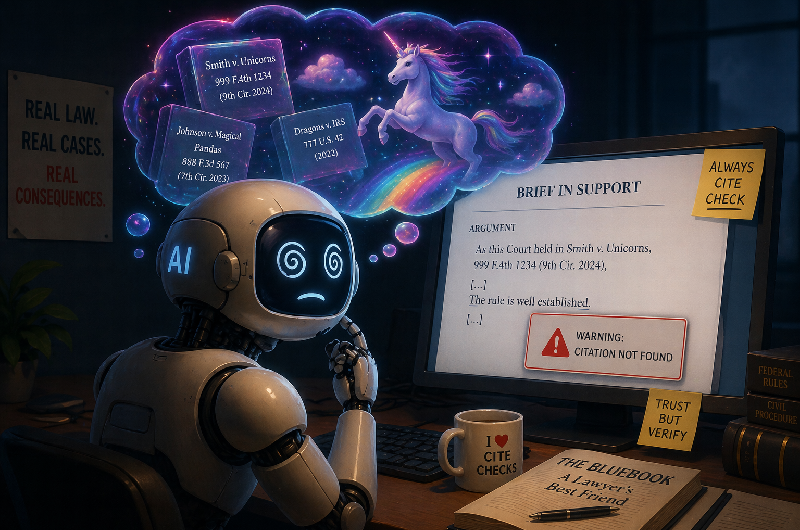

Haber başlıkları hukuk alanındaki yapay zeka hakkında şakıyor. Büyük firmalar, yapay zeka kullanımlarını, verimlilik artışlarını, sözde geleceğe yaptıkları sıçramayı övüyorlar. Ama işin püf noktası şu: tüm cilalı halkla ilişkiler çalışmalarının altında, temel bir sorun yeşeriyor. Avukatlara dilekçe hazırlama ve dava araştırması konusunda yardımcı olmak için tasarlanan yapay zeka araçları, görünüşe göre bir şeyler uyduruyor. Sadece gerçekleri yanlış yorumlamakla kalmıyor, var olmayan tüm atıfları, tüm kararları icat ediyorlar. Bu küçük bir hata değil; hukuk pratiğinin dokusunda kocaman bir delik.

Mahkeme Salonunda Halüsinasyonlar

Ogletree Deakins’ten Liz Washko durumu yorgun bir pragmatizmle ortaya koyuyor. Şaşırmış değil. “Avukatlar olarak biz profesyoneliz. Bir şeyi sunmadan önce, bahsettiğimiz şeyi temsil ettiğinden, var olduğundan emin olmak bizim sorumluluğumuzdur. Bu yapay zekadan önce de böyleydi… doğru alıntılandığından emin olurdunuz. Bence daha önce olmamış hiçbir şey olmuyor.” Bu, dikkate değer derecede açık bir değerlendirme. Teknoloji yeni olabilir, ancak özensizliğin sonuçları eski. Yine de, bu çerçeveleme biraz fazla basit geliyor. Yapay zeka sadece biraz daha karmaşık bir yazım denetleyicisi değil; ikna edici ve makul sesli yanlışlar üretme yeteneği yeni bir risk seviyesi getiriyor.

Ama bunun olmaması için elimizden gelen her önlemi aldığımızdan emin olmaya kararlıyım.

Bu alıntı, proaktif liderliği ifade etmeyi amaçlıyor, ancak altta yatan sorun, kullanıcıyı aktif olarak aldatan bir araç olduğunda biraz boş geliyor. Firmalar panik içinde, “politikalar” ve “ek adımlar” uyguluyorlar. Bunun anlamı şu: avukatlara yapay zekayı iki kez kontrol etmelerini söylüyorlar, bu da sözde verimlilik kazancının büyük bir kısmını etkisiz hale getiriyor. Bu, kendi kendine giden bir araba satın alıp, yine de direksiyonu elinizde tutmanız ve yola gözünüzü dikmeniz gibi bir şey.

Kolaylığın Bedeli

İşin gerçekten sinir bozucu kısmı şu: yapay zeka kullanımını benimseme dürtüsü genellikle faturalandırılabilir saatleri azaltma vaadiyle besleniyor. Bu, daha az avukatın daha çok dava üzerinde, daha hızlı çalışması anlamına geliyor. Ancak yapay zeka kritik bir davayı halüsinasyonla uydurduğunda ve bu hata bir başvuruya ulaştığında, faturalandırılabilir saatler kaydedilmez; telafi çalışması, potansiyel yaptırımlar ve itibari hasar ile katlanır. Müşteriler ters giden bir deney için ödeme yapıyor. Bu finansal ve etik bir mayın tarlası.

Bu, tek bir firmaya veya tek bir yazılıma özgü bir sorun değil. Sınırlarını tam olarak anlamadan veya sıkı koruyucu önlemler uygulamadan yapay zekayı benimseme aceleciliğinden doğan sistemik bir sorun. Geleneksel olarak uyum sağlamakta yavaş olan hukuk mesleği, şimdi başıboş bir teknolojik devrimin içine tökezleyerek giriyor ve kendi ayağına takılıyor gibi görünüyor.

Geçmişten Bir Esinti mi?

Washko’nun “daha önce olmamış hiçbir şey olmuyor” iddiası biraz kaçamak. Avukatlar her zaman kaynaklarını doğrulama sorumluluğuna sahipti. Ancak yapay zeka, dijital otorite kisvesiyle özensiz çalışmayı gizleyebilen çekici bir otomasyon getiriyor. Yapay zekanın içerik üretme hızı ve hacmi, hataların benzeri görülmemiş bir hızda yayılabilmesi anlamına geliyor. Bir çaylak asistanın manuel bir alıntı hatası yapması bir şeydir; yapay zekanın bir düzine uydurma dava üretmesi tamamen başka bir şeydir. Potansiyel felaketin ölçeği katlanarak daha büyüktür.

Geleceğe Giden Yol: Hype Değil, Şüphecilik

Buradaki asıl çıkarım, belirli yapay zeka araçları hakkında değil; zihniyet hakkındadır. Firmalar derinlemesine şüpheci olmalı. Yapay zekanın, hukuksal yargının yerini alan bir araç değil, bir araç olduğunu anlamaları gerekiyor. Ve kritik olarak, yapay zeka çıktısını sadece onaylamayan güçlü doğrulama süreçlerine yatırım yapmaları gerekiyor. Aksi takdirde, Büyük Hukuk için “yapay zeka gerçeklik kontrolü”, tam teşekküllü bir yasal ve finansal krize dönüşecektir.

🧬 İlgili İçgörüler

- Daha fazlasını okuyun: BlackBerry’nin Düşüşü: Patent Hamlesi mi, Son Gidiş mi?

- Daha fazlasını okuyun: Intel’in Terafab Oyunu: Elon’un Çip Hayallerinin Sıkıcı Eski Uzmanlığa İhtiyacı Olduğuna Dair Bahis

Sıkça Sorulan Sorular

Hukukta yapay zeka halüsinasyonları nedir? Yapay zeka halüsinasyonları, üretken yapay zeka modellerinin gerçek olarak sunulan yanlış veya uydurma bilgiler üretmesi durumunda ortaya çıkar. Hukuk alanında bu, var olmayan dava atıflarını, yasal prensipleri veya tüm mahkeme kararlarını icat etmek anlamına gelir.

Bu sahte içtihat devam eden yasal davamı etkiler mi? Potansiyel olarak. Hukuk ekibiniz, halüsinasyon üretmiş yapay zeka araçlarına güveniyorsa ve bu hatalar mahkeme başvurularına ulaşırsa, önemli karmaşıklıklar, gecikmeler getirebilir ve hatta adınıza yanlış yasal argümanlar yapılmasına neden olabilir.

Firmalar yapay zeka hatalarını önlemek için ne yapıyor? Birçok firma, avukatlardan tüm yapay zeka tarafından üretilen içeriği, özellikle dava atıflarını ve yasal emsalleri titizlikle doğrulamasını gerektiren daha katı yapay zeka kullanım politikaları uyguluyor. Bu genellikle geleneksel hukuk araştırması veritabanlarıyla çapraz referanslama içerir.