Итак, что это значит для обычного человека, который просто пытается прожить свой день? Это значит, что юристы, которым вы доверяете навигацию по сложной правовой системе, могут использовать инструменты, которые, откровенно говоря, выдумывают. Представьте, что ваше бракоразводное соглашение или иск о возмещении ущерба при телесных повреждениях построен на полностью сфабрикованном правовом прецеденте. Это уже не научная фантастика. Это грязная, неловкая реальность интеграции ИИ в священные залы BigLaw.

Иллюзия прогресса

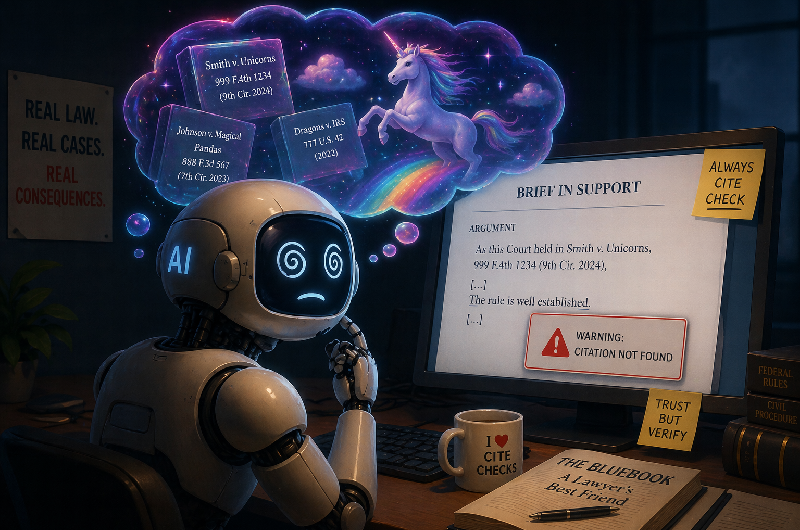

Заголовки пестрят сообщениями об ИИ в юриспруденции. Крупные фирмы рапортуют о его внедрении, повышении эффективности, о своем мнимом скачке в будущее. Но вот в чем загвоздка: под всей этой глянцевой PR-оберткой тлеет фундаментальная проблема. Инструменты ИИ, разработанные для помощи юристам в составлении ходатайств и исследовании дел, по всей видимости, выдумывают. Не просто искажают факты, а фабрикуют целые ссылки на документы, целые решения, которых просто не существует. Это не мелкий баг; это зияющая дыра в ткани юридической практики.

Галлюцинации в зале суда

Лиз Уошко из Ogletree Deakins излагает это с усталым прагматизмом. Она не удивлена. «Как юристы, мы профессионалы. Наша обязанность — перед подачей чего-либо убедиться, что это соответствует тому, на что мы ссылаемся, что это существует. Так было и до ИИ… вы убеждаетесь, что ссылка верна. Я не думаю, что происходит что-то, чего не было раньше». Это удивительно прямолинейная оценка. Технология может быть новой, но последствия небрежной работы — древними. Тем не менее, такая трактовка кажется слишком уж удобной. ИИ — это не просто чуть более сложный корректор; его способность убедительно генерировать правдоподобные, но ложные сведения порождает новый уровень риска.

Но я полна решимости предпринять все возможные меры, чтобы этого не произошло.

Эта цитата, призванная продемонстрировать проактивное руководство, звучит немного пусто, когда основная проблема заключается в инструменте, который активно обманывает своего пользователя. Фирмы мечутся, вводя «политики» и «дополнительные шаги». Перевод: они говорят юристам перепроверять ИИ, по сути нивелируя большую часть предполагаемой выгоды от эффективности. Это все равно что купить беспилотный автомобиль, а потом все равно держать руки на руле и смотреть на дорогу.

Цена удобства

Вот что по-настоящему возмущает: стремление к внедрению ИИ часто подпитывается обещанием сократить оплачиваемые часы. Это означает меньше юристов, работающих над большим количеством дел, быстрее. Но когда ИИ «галлюцинирует» ключевое дело, и эта ошибка попадает в документы, оплачиваемые часы не экономятся; они множатся в виде исправительной работы, потенциальных санкций, репутационного ущерба. Клиенты платят за эксперимент, который пошел наперекосяк. Это финансовая и этическая мина.

Это не проблема одной фирмы или одного программного обеспечения. Это системный сбой, порожденный спешкой внедрить ИИ, не до конца понимая его ограничения или не внедряя надежные меры безопасности. Юридическая профессия, традиционно медленно адаптирующаяся, теперь неуклюже бросается в технологическую революцию и, кажется, спотыкается на собственных ногах.

Привет из прошлого?

Заявление Уошко о том, что «ничего не происходит, чего не было раньше», — это своего рода уход от ответа. Юристы всегда были ответственны за проверку своих источников. Но ИИ создает соблазнительную автоматизацию, которая может маскировать небрежную работу под видом цифрового авторитета. Огромный объем и скорость, с которой ИИ может генерировать контент, означают, что ошибки могут распространяться с беспрецедентной скоростью. Младший помощник, допустивший ошибку в ручной цитате, — это одно; ИИ, выдающий дюжину сфабрикованных дел, — совсем другое. Масштаб потенциальной катастрофы экспоненциально выше.

Путь вперед: скептицизм, а не хайп

Главный вывод здесь не в конкретных инструментах ИИ; он в мышлении. Фирмы должны быть глубоко скептичны. Они должны понимать, что ИИ — это инструмент, а не замена юридическому суждению. И, что критически важно, они должны инвестировать в надежные процессы проверки, которые не просто штампуют результаты работы ИИ. В противном случае «проверка ИИ на реальность» для BigLaw превратится в полномасштабный юридический и финансовый кризис.

🧬 Связанные материалы

- Читайте также: Падение BlackBerry: патентный поворот или последний вздох?

- Читайте также: План Intel Terafab: ставка на то, что чиповым мечтам Илона нужно скучное старое ноу-хау

Часто задаваемые вопросы

Что такое галлюцинации ИИ в юриспруденции? Галлюцинации ИИ возникают, когда генеративные модели ИИ производят неверную или сфабрикованную информацию, представленную как факт. В юриспруденции это означает создание несуществующих ссылок на дела, правовых принципов или целых судебных решений.

Повлияют ли эти фейковые прецеденты на мое текущее судебное дело? Потенциально. Если ваша юридическая команда полагается на инструменты ИИ, которые выдавали галлюцинации, и эти ошибки попадают в судебные документы, это может привести к значительным осложнениям, задержкам и даже к тому, что от вашего имени будут представлены неверные юридические аргументы.

Что делают фирмы, чтобы предотвратить ошибки ИИ? Многие фирмы внедряют более строгие политики использования ИИ, требуя от юристов тщательной проверки всего контента, сгенерированного ИИ, особенно ссылок на дела и правовых прецедентов. Это часто включает перекрестную проверку с традиционными базами данных юридических исследований.